Imaginez une voiture autonome qui fonce droit vers cinq piétons. Le système peut dévier sur le trottoir et en tuer un seul. Doit-il le faire ? Cette question n’est pas nouvelle. Elle existe depuis 1967, quand la philosophe Philippa Foot a posé le problème du trolley pour la première fois. Mais aujourd’hui, elle quitte les salles de classe pour devenir un vrai problème d’ingénierie.

Le dilemme change tout. Il ne s’agit plus d’une expérience de pensée abstraite. C’est une question qui va déterminer comment nous programmons les machines qui partagent nos routes, nos hôpitaux, nos salles de crise.

Qu’est-ce que le dilemme du trolley exactement ?

Voici l’expérience : un trolley (tramway) fonce sur une voie où se tiennent cinq personnes. Vous êtes près d’un levier. Si vous le tirez, le trolley bascule sur une autre voie où se tient une seule personne. Vous devez choisir : laisser cinq mourir ou en tuer activement une seule ?

La plupart des gens tirent le levier. Le dilemme du trolley révèle une asymétrie morale profonde : nous tolérons mieux une action qui sauve cinq vies au prix d’une mort qu’une inaction qui laisserait cinq personnes mourir.

Foot a créé ce dilemme pour explorer les limites de l’utilitarisme, cette théorie éthique qui dit que le bien c’est ce qui maximise le bonheur total. Le trolley montre que nous ne raisonnons pas comme des calculatrices. Nos choix moraux sont liés au contexte, à la responsabilité personnelle, à ce que nous avons provoqué.

En 2014, Edith Brown Weiss et ses collègues ont réalisé une étude massive auprès de 2 millions de personnes à travers 190 pays pour explorer ces intuitions morales. Les résultats ont montré des variations culturelles, mais une tendance globale reste : tuer directement déplaît plus que laisser mourir.

Comment ce dilemme s’applique-t-il à l’intelligence artificielle ?

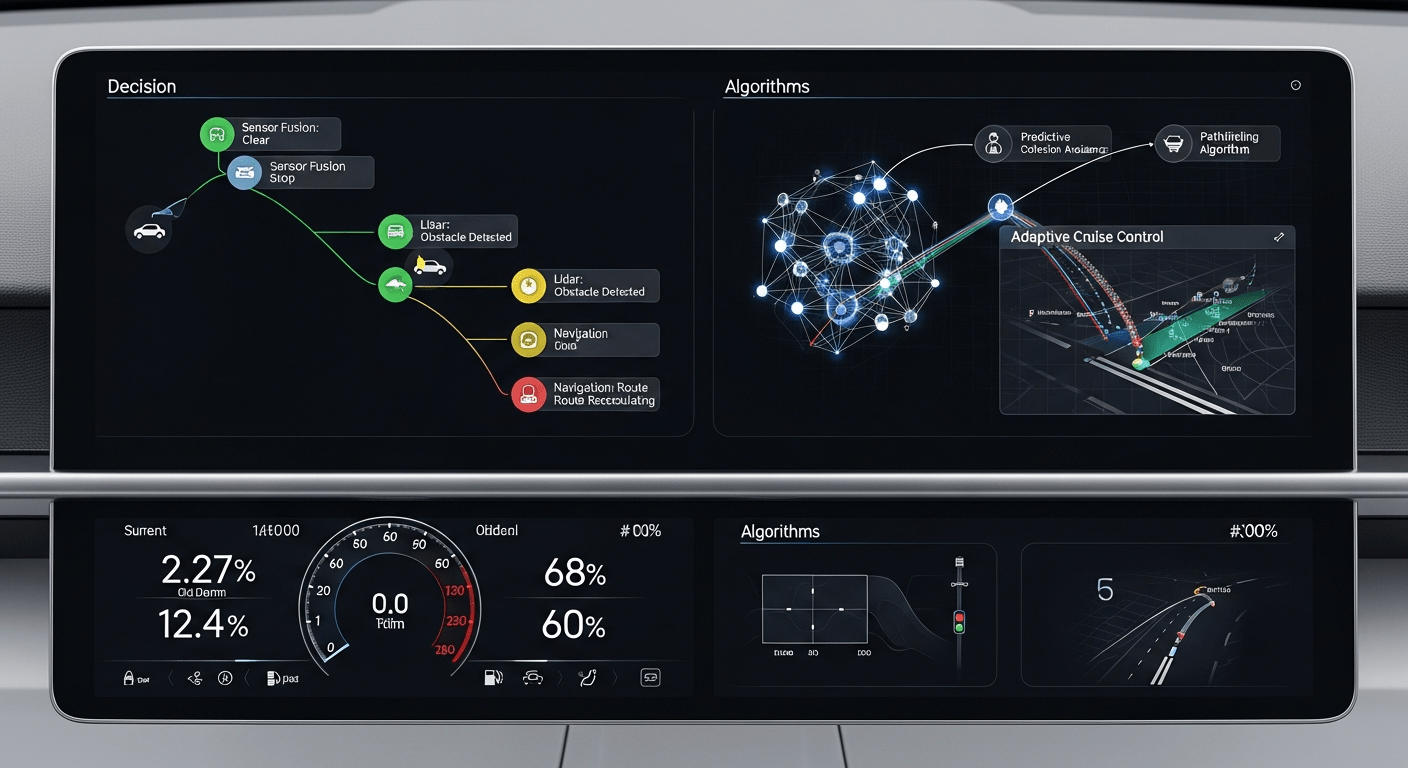

Une voiture autonome Tesla 2024 peut traiter 230 images par seconde. Elle doit prendre des décisions en millisecondes. Si elle détecte une collision inévitable, son algorithme doit choisir. Sauver ses passagers en heurtant des piétons ? Mettre ses passagers en danger pour protéger les autres ? L’intelligence artificielle doit trancher exactement comme le trolley.

La différence : personne ne tire le levier. C’est le code qui le fait.

Quand vous programmez une voiture autonome, vous écrivez littéralement ses valeurs morales en bits et en octets. Vous décidez : maximiser les vies sauvées ? Protéger les occupants du véhicule ? Protéger les cyclistes plutôt que les piétons ? Chaque choix d’algorithme est un engagement éthique.

Mercedes-Benz a été particulièrement honnête en 2016. Leur PDG a déclaré que leur voiture autonome protégerait toujours ses passagers en premier, même si cela tuait des innocents. C’était brutal. C’était aussi une décision éthique, même si personne ne l’a formulée en ces termes.

Pourquoi les valeurs morales dans l’IA sont impossibles à programmer ?

Vous croyez qu’il suffit d’écrire : « Sauve le maximum de vies ». C’est faux. Le code ne comprend rien à la moralité.

Prenez une décision qui semble simple : maximiser les vies. Une voiture autonome pourrait interpréter cela comme « freine à 200 kilomètres par heure pour éviter tout risque ». Elle pourrait aussi interpréter cela comme « écrase les piétons, c’est un problème local isolé, mais continue ta mission qui sauve 100 vies ailleurs ».

L’algorithme ne voit pas la moralité. Il voit des variables, des conditions, des trade-offs. L’IA ne peut pas comprendre que tuer quelqu’un est différent du point de vue moral que de le laisser mourir. Elle ne connaît que les chiffres.

Ajoutez la complexité réelle : en cas d’accident, il y a rarement 5 personnes vs 1 personne en ligne. Il y a des enfants, des personnes âgées, des gens qui n’ont pas choisi d’être là. Comment programmer ça ? Doit-on valoriser une vie d’enfant plus qu’une vie d’adulte ? Qui fait ce choix ? Qui assume la responsabilité ?

En 2018, le MIT a lancé « Moral Machine », un jeu en ligne où des millions de gens ont voté sur les scénarios du trolley appliqués aux voitures autonomes. Les résultats ont montré que les gens voulaient sauver plus de vies. Mais ils voulaient aussi que d’autres acceptent les sacrifices, pas eux-mêmes.

Qui est responsable quand l’IA prend une décision immorale ?

Ici, le problème devient légal et politique. Une voiture autonome tue un piéton en choisissant de le frapper plutôt que de frapper un groupe. Qui poursuivre ? Le fabricant ? Le programmeur ? Le propriétaire du véhicule ? Le gouvernement qui a autorisé le système ?

Le code n’a pas d’intention. Il n’a pas conscience. Mais les choix qu’on y insère en ont une. Et personne n’en parle ouvertement.

En 2019, Uber a eu un accident mortel avec sa voiture autonome à Tempe, en Arizona. Une femme a été tuée. L’enquête a montré que le système avait détecté le piéton, mais que le logiciel de freinage d’urgence avait été désactivé pour des raisons de « confort ». C’était une décision éthique déguisée en choix technique. Le problème : personne n’avait voté pour cette éthique. Personne n’avait signé pour accepter ce risque.

La responsabilité devient floue. La moralité aussi.

Les enjeux réels vont bien au-delà des voitures

Le dilemme du trolley nous fait penser aux routes. Mais l’IA prend des décisions éthiques partout. Dans les hôpitaux, les systèmes décident qui reçoit un traitement coûteux et rare. Algorithme utilitaire : sauve le plus grand nombre. Mais cela signifie sacrifier les cas difficiles, les patients âgés, les gens avec peu d’espoir de survie.

Dans les prisons, les systèmes prédisent qui va récidiver. Cela influence les décisions de libération. Si l’algorithme se trompe, vous gardez quelqu’un en prison. Si vous ignorez l’algorithme, quelqu’un tue. Dilemme du trolley. Pas de levier, juste du code.

Dans les guerres, les drones doivent décider : cette silhouette sur l’écran thermique est-elle un civil ou une cible ? Frapper signifie sauver potentiellement dix soldats alliés. Ne pas frapper signifie risquer dix morts alliés. Le dilemme du trolley s’applique avec des vraies armes et du vrai sang.

En 2021, une étude de l’Université de Stanford a montré que les systèmes de recommandation YouTube avaient optimisé pour l’engagement plus que pour la vérité. Cela a amplifié les contenus extrémistes. Was-ce une décision éthique ? Oui. Était-elle deliberate ? Non. Elle était cachée dans une métrique banale : « maximise le temps passé ».

Comment devrions-nous vraiment programmer la moralité dans l’IA ?

Certains disent : laissez les philosophes décider. Mauvais. Les philosophes ne savent pas coder. Ils ne comprennent pas les contraintes techniques.

D’autres disent : laissez les ingénieurs décider. Pire. Les ingénieurs optimisent pour ce qui est mesurable, pas pour ce qui est juste.

La bonne réponse : ne décidez pas secrètement. Décidez ouvertement, ensemble, avec transparence.

Cela signifie : avant de déployer une IA qui prend des décisions éthiques, on dit à la société exactement comment elle va agir. On explique : cette voiture autonome protégera ses passagers en priorité. Cette IA hospitalière refusera les traitements coûteux aux cas sans espoir. Ce drone frappera sur suspicion, pas sur preuve.

Puis on vote. On débat. On accepte ou rejette. C’est difficile. C’est lent. Mais c’est la seule façon d’avoir une IA qui reflète nos valeurs au lieu de les imposer.

En 2022, l’Union européenne a proposé le AI Act, une régulation qui force les fabricants à documenter les risques éthiques de leurs systèmes. C’est un début. Pas parfait. Mais c’est reconnaître que l’intelligence artificielle ne peut pas rester un choix technique caché dans un détail d’implémentation.

Le vrai enjeu : qui décide des valeurs que l’IA va défendre ?

C’est la question qui va définir notre siècle. Pas comment construire une meilleure IA. Mais quelle IA on veut construire.

Le dilemme du trolley ne sera jamais résolu. Les philosophes débattent depuis 1967 et ils ne sont pas arrivés à un consensus. Pourquoi ? Parce qu’il n’existe pas de réponse universelle. Nos intuitions morales dépendent de notre culture, notre histoire, nos valeurs.

Mais si vous donnez cette responsabilité à une entreprise de tech pour décider silencieusement ? Vous avez un problème. Elle va choisir ce qui minimise sa responsabilité légale et maximise son profit. Ce n’est pas une éthique. C’est un business plan.

Nous avons trente ans avant que l’IA prenne véritablement ces décisions à grande échelle. Nous avons le temps d’en parler. De voter. De décider ensemble ce qu’on accepte et ce qu’on refuse.

Le dilemme du trolley n’a pas de bonne réponse. Mais ignorer la question, c’est la pire réponse possible.