En novembre 2023, des milliers d’artistes ont intenté un procès collectif contre Stability AI, accusant la plateforme d’avoir utilisé leurs œuvres sans consentement pour entraîner ses algorithmes. Ce n’était pas une querelle de niche. C’était la première bataille judiciaire massive entre le monde de l’art traditionnel et l’IA.

La question ne se pose plus : l’intelligence artificielle générative existe. Elle crée des images en secondes, compose de la musique, rédige des poèmes. Mais elle le fait en ingérant des milliards d’œuvres humaines. Et personne ne demandait la permission.

Comment les systèmes d’IA apprennent-ils à créer ?

Les modèles d’IA et art fonctionnent sur un principe simple : la machine apprend en regardant. Elle absorbe des images, des textes, des sons existants, puis reconnaît des patterns. Elle identifie ce qui fait un « Rembrandt » ou une « composition de jazz ».

Midjourney a été entraîné sur des milliards d’images extraites d’Internet. Stable Diffusion a utilisé un dataset de 2,3 milliards d’images sans autorisation explicite. DALL-E 3 d’OpenAI a ingéré d’innombrables créations provenant de banques d’images et de sites d’artistes.

Le problème : ces données ont un propriétaire. Une illustrateur dont l’œuvre a nourri l’algorithme n’a jamais signé de contrat. Elle ne reçoit aucune compensation. Et maintenant, l’IA produit des visuels qui ressemblent à son style sans qu’elle y soit pour rien.

Les droits d’auteur tiennent-ils face à l’IA générative ?

Voilà la vraie question juridique. Le droit d’auteur protège les créations originales depuis 1886 (Convention de Berne). Mais comment s’applique-t-il quand une machine apprend en copiant puis génère du contenu neuf ?

Les avocats qui défendent les artistes plaident que l’création artistique humaine mérite protection. Même si Midjourney génère une image unique, elle le fait en s’appuyant sur le vol de données. C’est comme construire une fortune en pillant des brevets. Le résultat peut être original, mais le processus est vicié.

Du côté de l’IA, les défenseurs invoquent le « fair use » (utilisation équitable) américain. Entraîner une machine sur des données existantes serait comparable à l’apprentissage humain. Un peintre regarde les maîtres, s’en inspire, puis peint son propre tableau. Pourquoi l’IA ne pourrait-elle pas faire la même chose ?

Mais il y a une différence majeure. L’IA ne s’inspire pas consciemment. Elle indexe littéralement chaque pixel d’une œuvre. Et contrairement à un peintre qui oublie ce qu’il a vu, l’algorithme le stocke quelque part dans ses couches de neurones.

En mars 2024, un tribunal américain a rejeté partiellement l’argument du « fair use », reconnaissant que l’apprentissage massif d’œuvres protégeables pose problème. Mais le dossier est loin d’être tranché mondialement.

Quel impact sur la rémunération et l’emploi des artistes ?

Les chiffres parlent. Une enquête 2024 de l’association des illustrateurs américains révèle que 52 % des professionnels craignent une baisse de leurs commandes. Certains studios de graphisme commencent déjà à remplacer les juniors par des outils d’IA.

L’futur du travail créatif s’assombrit pour ceux qui ne s’adaptent pas. Les petits projets (bandeaux publicitaires, illustrations basiques, musiques d’ambiance) sont les premiers menacés. Un client qui coûtait 500 euros en freelance peut maintenant utiliser une IA pour 5 euros.

Mais il y a plus grave. Les artistes ne reçoivent rien pour avoir participé involontairement à cette révolution. Leurs données ont de la valeur. Enormément de valeur. Les entreprises d’IA se cotent en milliards. Les artistes qui ont fourni la matière première ? Zéro euro.

Certaines initiatives tentent de corriger ça. En 2023, Adobe a lancé Firefly en promettant de ne s’entraîner que sur des images libres ou avec permission. C’est rare. Et c’est pas encore la norme du marché.

Qu’est-ce qui compte vraiment comme créativité humaine ?

Cette question philosophique devient subitement très concrète. Si une IA génère une image magnifique d’un seul prompt, est-ce de l’art ? Qui est l’artiste : la personne qui tape le texte ou l’équipe qui a construit le modèle ?

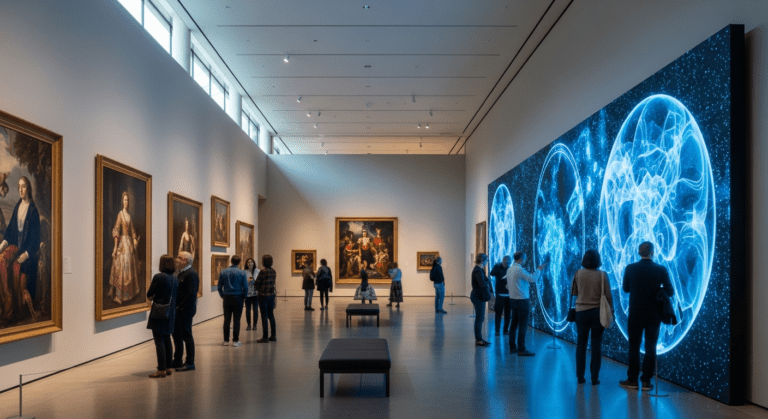

Les galeries ne savent pas quoi faire. Certaines refusent les créations purement générées par IA. D’autres les acceptent à condition que l’intelligence artificielle soit transparente dans le processus. En 2024, une œuvre créée avec Midjourney a été soumise aux Oscars pour le meilleur court-métrage. Elle a été disqualifiée sur la base des droits d’auteur.

La vraie distinction émerge : il y a une différence entre utiliser l’IA comme outil (comme Photoshop) et la laisser créer seule. Un artiste qui peint à partir d’une base générée par IA reste auteur. L’IA qui génère sans direction humaine claire ? C’est un domaine gris.

Comment l’éthique IA redessine les règles du jeu ?

L’éthique IA n’est pas juste une phrase marketing. C’est maintenant une attente légale. L’Union européenne l’a intégré dans son AI Act (en vigueur depuis 2024). Transparence obligatoire, responsabilité des entreprises, droits minimums des créateurs.

Les gouvernements commencent à agir. France, Allemagne et Canada étudient comment compenser les artistes dont les données ont été utilisées. Pas encore de consensus global, mais le mouvement est là.

Les entreprises d’IA adaptent leur stratégie. OpenAI a signé des accords avec plusieurs médias pour un usage transparent. Getty Images poursuit Stability AI pour violation massive de droits. Le marché change sous la pression.

Vers un équilibre entre innovation et protection des artistes ?

La solution n’est pas d’arrêter l’IA. C’est trop tard de toute façon. Elle est là, elle progresse, elle ne disparaîtra pas.

Mais on peut imposer des règles. Opt-in obligatoire : les données d’un artiste ne peuvent être utilisées que s’il a donné son accord. Compensation juste : si ses œuvres alimentent un modèle commercial, elle reçoit une part des revenus. Transparence radicale : chaque création générée doit afficher ce qui l’a alimentée.

Quelques pistes émergent. La startup Spawning AI a créé un outil permettant aux artistes de « refuser » que leurs œuvres servent à entraîner des IA. C’est un début. GitHub a lancé une option pour exclure du code d’une formation IA. C’est le modèle qu’il faut répliquer.

L’avenir du travail créatif passera par un contrat social. Les artistes acceptent l’IA, mais en échange ils reçoivent une part du gâteau. Pas de compensation ? Pas de données. C’est la seule négociation viable.